Heute wagen wir einen Makro-Blick auf KI, das große Nachfrage sieht, sich aber immer deutlicher einigen Nadelöhren außerhalb der eigentlichen Technologie gegenüber sieht, die am Ende vielleicht zu eng sind für die Erwartungen an die Technologie.

Besonders der China-Aspekt unten könnte sehr wichtig werden. Wie wir bereits neulich im Briefing besprochen hatten: Man kann wichtige Wirtschaftszweige wie KI heute nicht mehr ohne Geopolitik denken.

Nächste Woche wird es kein Briefing geben. Das nächste Briefing erscheint übernächste Woche.

Marcel

Im Fokus der Ausgabe:

OpenAIs Billionen-Wette stößt an physische Grenzen: Das explosive Wachstum von KI trifft auf reale Nadelöhre wie Energiebedarf und Infrastruktur.

China nutzt den Hebel der seltenen Erden: Peking setzt seine Dominanz bei kritischen Rohstoffen als Waffe im Wirtschaftskrieg ein, um auch die westliche Chip-Produktion und den KI-Sektor zu treffen. (und über Bande damit die gesamte US-Wirtschaft)

Deutschlands KI-Infrastruktur fällt zurück: Ein neuer Report zeigt, dass Deutschland bei der KI-Rechenkapazität international den Anschluss zu verlieren droht.

Neue Player, neue Märkte: Während in den USA Robotik-Startups durchstarten, drängen chinesische Tech-Firmen mit selbstfahrenden Autos aggressiv auf den europäischen Markt.

Außerdem: Walmart bei ChatGPT, Social bei Sora, mehr Unternehmen bauen humanoide Roboter und mehr

Zitat des Tages

the choice isnt between "code written by ai" and "artisan handwritten code written by john carmack"

the choice is between "code written by ai" and "something that could have existed, but didnt"

Thema der Woche

Blasen, Wetten, Grenzen & Kapazitäten: OpenAIs Fünfjahres-Geschäftsplan, um die Ausgabenversprechen in Höhe von 1 Billion Dollar zu erfüllen

Parallel zum Best-Case-Szenario für OpenAI, über das wir hier letzte Woche gesprochen haben, hat die Financial Times über die Pläne und den Stand bei OpenAI geschrieben.

Die Fakten:

- OpenAI plant neue Einnahmequellen und Finanzierungsmodelle, um über $1 Bio. an Verpflichtungen zu stemmen.

- Ziel: maßgeschneiderte Produkte für Firmen und Regierungen, Shopping-Tools, Video-Service Sora, AI‑Agenten und Hardware.

- Verpflichtung: >26 GW Kapazität von Oracle, Nvidia, AMD, Broadcom mit Kosten über $1 Bio. in 10 Jahren. (Analysten: 20 GW entspricht ~20 Atomreaktoren an Strombedarf.)

- Aktuell ~$13 Mrd. ARR, 800 Mio. Nutzer, 5% zahlend; OpenAI will Zahl der Abonnenten verdoppeln.

- Hohes Defizit: H1‑Betriebsverlust ~ $8 Mrd.; Infrastruktur bislang von Partnern vorfinanziert; OpenAI setzt auf fallende Kosten und weitere Kapitalrunden.

Anmerkungen:

Zuerst: ChatGPT wird erst Ende November drei Jahre alt und liegt bereits bei 13 Milliarden $ jährliche wiederkehrende Einnahmen. Zum Vergleich: Zalando, das einzige Startup der letzten 2 Jahrzehnte, das zu einem deutschen, börsennotierten Konzern herangewachsen ist, hat für 2025 die Prognose herausgegeben, auf einen Umsatz von 12,1 bis 12,4 Milliarden Euro zu kommen. (Handelsbatt) Das erreichen sie im 17. Jahr ihres Bestehens.

Gleichzeitig wachsen OpenAI und Anthropic (und sicher auch andere wie Together.ai) rasant weiter und haben „nur“ ein Kapazitätsproblem, kein Nachfrageproblem.

Reuters reports that the company is on track to hit $9 billion in annualized revenue this year and projects as much as$26 billion annualized revenue next year. (It was at $1 billion in ARR in January.)

1 Milliarde $ ARR letztes Jahr, dieses Jahr 9 Milliarden $ und nächstes Jahr 26 Milliarden $ ARR. Dauert nicht mehr lang, und wir reden hier über ein richtiges Geschäft.

Neben dem irrsinnigen Umsatzwachstum ist auch die schiere Nutzungsgröße etwas, das vielen in den breiteren Debatten gar nicht deutlich zu sein scheint. Noch vor dem dritten Geburtstag hat ChatGPT 800 Millionen wöchentlich aktive Nutzer:innen erreicht. Facebook hat ein Vielfaches dieser Zeit gebraucht. Preisfrage: Wer gehört zu den größten Werbeplattformen der Welt? Richtig, Meta mit Facebook und Insta. Follow-Up-Frage: Könnte ChatGPT neben dem Abo-Modell zusätzlich ein vergleichbar florierendes Werbemodell etablieren? Follow-Up-Frage: Wo hören die Einnahmequellen auf, wenn man Leute dazu bewegen kann, für ein Abo zu zahlen, Nutzungszahlen und -art wie Facebook und Google aufbaut (Werbung), eigene Gadgets baut (Apple) und mit E-Commerce-Integration auch auf Konfrontationskurs mit Amazon geht (Gebühren von Händlern)? Follow-Up-Frage: Gonna be a man, ask her out?

Vor diesem Hintergrund muss man die massiven Investitionen sehen. Diese Investitionen und Vereinbarungen, eingefädelt vom Deal-King Altman, sind natürlich per Definition Wetten. Weil niemand weiß, wo die Reise hingehen wird. Aber aktuell sieht es aufgrund der auf sie von allen Seiten einprasselnden Nachfrage noch nach geringem Risiko aus.

Geringes Risiko, wenn man nur auf die Nachfrage schaut, die nur von Rechenkapazität, Chipeffizienz und Energiekosten beschränkt wird.

Anders sieht es aus, wenn man auf eben diese Schranken schaut.

Greg Brockman, the company’s president, last week said recent spending commitments would pay for themselves: “If we had 10 [times] more compute [computing power], I don’t know if we’d have 10 [times] more revenue, but I don’t think we would be that far.”

Es dürfte kaum noch einen erwachsenen Menschen im Westen geben, der/die nicht weiß, was ChatGPT ist. Diese enorme Markenwahrnehmung geht einher mit der enormen Nützlichkeit der Technologie. Für Anthropic und Co. arbeitet auch letzteres, aber ihnen fehlt ersteres (die populäre Marke).

Aber kommen wir zu den Grenzen:

These ambitious plans will need to become reality if OpenAI is to meet its liabilities, as the group has made funding commitments that dwarf its income. In the past month, chief executive Sam Altman has committed to take more than 26 gigawatts of capacity from Oracle, Nvidia, AMD and Broadcom, at a rough cost of well over $1tn over the next decade, according to FT calculations. [...]

The company’s deals with AMD and Nvidia are staggered so OpenAI will pay as new capacity is developed. But 20GW of capacity would require power roughly equivalent to that provided by 20 nuclear reactors, and analysts have questioned whether it is realistic for that demand to be met by a single company.

Wo soll's herkommen? Vor allem kurzfristig? Innerhalb der nächsten 3 Jahre? Selbst wenn kleinere modulare Atomkraftwerke regulatorisch einfacher genemigt und damit zu bauen werden, wird Energiezubau länger dauern. Wer hält es für realistisch, dass im gesamten Westen in den nächsten 10 Jahren pro Jahr 2 neue Kernkraftwerke gebaut werden?

Das heißt: Die Obergrenze für KI-Nutzung liegt neben der steigenden Effizienz der High-Tech-Chips (die Energiebedarf senken kann) auch beim Zubau von Energie. Neben, wie wir hier bereits mehrfach diskutiert haben, den organisatorischen Herausforderungen. (Prozessveränderungen sind systemische Herausforderungen, die internen Widerstand überwinden müssen.)

Und: Ein nicht geringer Teil der künftigen Infrastruktur wird außerhalb des Westens liegen. (Ein Effekt zweiter Ordnung könnte sein, dass nicht nur das Training sondern auch die Inferenz, also die Nutzung, von KI außerhalb des Westens in Ländern wie China günstiger sein wird. Zusätzlich zu allem, was man so mit Strom anstellen kann.)

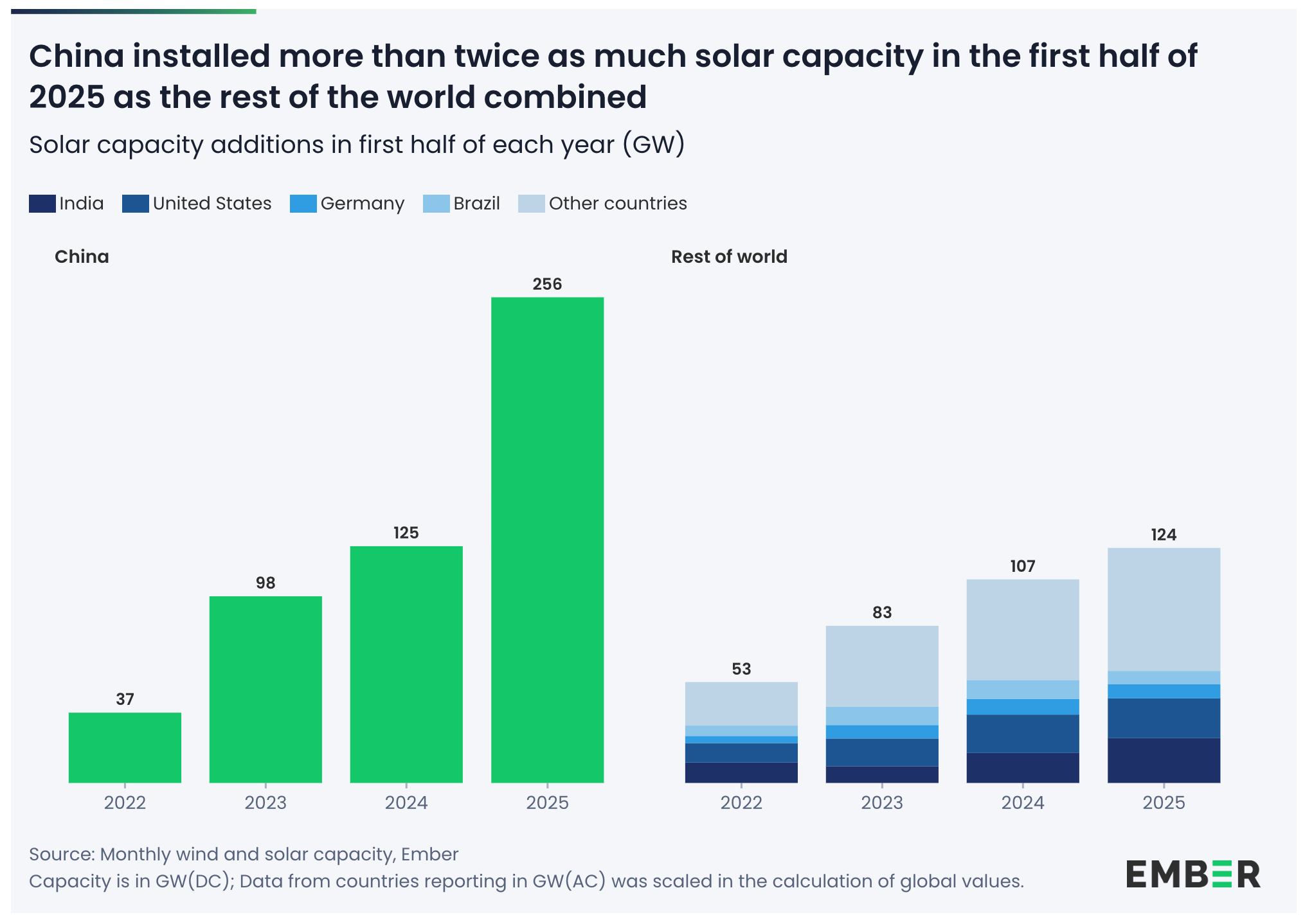

Länder wie China oder Bhutan werden globale Gewinner aufgrund ihrer Energiestrategie. China baut im Jahr zweimal so viel Solarkapazität auf, wie die USA insgesamt bis heute gebaut haben. Oder auch: zwei Mal so viel wie der Rest der Welt zusammen im selben Zeitraum:

China bereitet außerdem vor, den nächsten größten Staudamm der Welt in Betrieb zu nehmen. Der Drei-Schluchten-Damm in China kommt allein bereits auf 22,5 GW. Das nächste Staudamm-Projekt in China soll sogar auf 300 TWh Strom pro Jahr kommen. Bhutan ist ein kleines Land nördlich von Indien, das dank seiner geografischen Lage ebenfalls günstige Wasserkraftwerke bauen kann und explizit für KI aufbauen will. (Economist)

Deshalb rede ich seit langem davon, dass wir insgesamt von KI-Infrastruktur reden müssen, was nicht nur KI-Modelle, sondern eben auch Chips und Strom einschließt. Dieser Text von mir dazu in der FAZ ist bereits ein Jahr alt:

Wer steigende Nutzung und wachsende Ansprüche für das Training neuer KI-Modelle extrapoliert, entdeckt schnell mehr und mehr Engstellen. Heute sind die knappen KI-Chips der bedeutendste Flaschenhals. Der nächste ist der wachsende Strombedarf. Wenn KI wirklich transformativ für die gesamte Wirtschaft ist, dann müssen wir die Anforderungen an ihre Infrastruktur sehr viel ernster nehmen.

Passiert ist dazu in Europa in diesem Jahr nichts Nennenswertes.

But wait, there is more. OpenAI und Nvidia wollen beide auf die jeweils eigene Art (und teils gemeinsam) mit ihren zirkulären Deals parallele Investitionen anschieben, um vom gesamten Ökosystem möglichst viele Beschränkungen zu entfernen:

Two-thirds of the cost of developing new computing power goes towards semiconductors. OpenAI is aiming to stimulate the nascent chip financing market by offering enormous demand, and by forging novel contracts, such as its Nvidia and AMD deals.

Für Nvidia ist das sinnvoll: Was hat Nvidia davon, wenn sie liquides Kapital auf die hohe Kante legen, während ihre Abnehmer und deren Kunden langsamer wachsen, als es möglich wäre? Für OpenAI ist das auch sinnvoll: OpenAI schafft Nachfrage im Ökosystem (etwa für spezifische KI-Chips), so dass die Komponenten schneller für sie verfügbar werden und das gesamte Umfeld grundsätzlich mehr von ihren Produkten konsumieren kann.

Gleichzeitig merkte Ben Thompson diese Woche in seinem Sharptech-Podcast einen wichtigen Aspekt an. Indem OpenAI große Deals mit Nvidia, AMD, Oracle, Softbank und Co. eingeht, binden sie diese Unternehmen auch an das Schicksal von OpenAI. Das verschafft OpenAI langfristig zumindest ein Sicherheitspölsterchen, wenn’s an anderer Stelle mal knapp wird mit dem Kapital. (Da blinzelt er uns wieder an, der kleine Machiavelli namens Sam.)

Die Sinnhaftigkeit bei beiden Unternehmen ändert aber nichts daran, dass zirkuläre Deals (ich investiere in dich, damit du unter anderem mehr von meinen Produkten kaufen kannst) ein Symptom von Spekulationsblasen sind. Ein anderes Symptom sind Investitionen, die über Kredit finanziert werden. Die ersten drei Jahre des KI-Booms wurden finanziert von VC und vom Cashflow der Tech-Riesen. Jetzt gehen wir zur Krediten über. Namentlich vor allem bei Oracle.

Aber worauf ich eigentlich hinaus wollte: Seltene Erden.

Seltene Erden: Der Wirtschaftskrieg erreicht KI

Lesen Sie die ganze Geschichte

Melden Sie sich jetzt an, um die vollständige Geschichte zu lesen und Zugriff auf alle bezahlten Beiträge zu erhalten.

Abonnieren