Hi,

der Leak des Codes von Claude Code hatte alles: Der Code ist, wie man weiß, mit Claude Code selbst erstellt und größtenteils nur schwer aushaltbar für Programmierer:innen.

Die Rechenzentrums-Experten von Semianalysis haben den Take auf X, der den Bruch am deutlichsten macht:

NON-PROFESSIONAL & ENGAGEMENT BAIT: Anyone "classically trained" to write code pre-LLMs will take on look at the leaked Claude Code repo and see that it's a pile of unmaintainable slop. However, it is becoming increasingly clear that this doesn't actually matter. Coding is no longer a craft. No one cares how the code looks. All that matters is the utility of the program, with special exceptions made for mission critical considerations like security. Languages like TypeScript are just assembly at this point.

Software differenziert sich aktuell noch stärker aus.

Davon abgesehen, drei weitere Anmerkungen:

Erstens: Geleakt ist das lokale App-Gerüst rund um die KI-Modelle von Anthropic. Also die Produktseite, nicht die Modell/Technologie-Seite.

Hier stecken auf jeden Fall spannende Architektur-Inspirationen drin, die auch für europäische Startups relevant sind.

Zweitens: In Claude Code steckt bereits das noch nicht freigeschaltete Feature, das den nächsten Sprung in der KI-Nutzung darstellt: Proaktive, immer laufende Agenten. Wer zu viel Freizeit hat, kann das heute bereits mit OpenClaw umsetzen; für die Massen kommt es dieses Jahr in Claude Code, Cowork und ChatGPT.

Drittens: Wie robust sind die Prozesse bei Anthropic? Welche Auswirkungen hat die hohe Shipping-Frequenz auf die Qualität der Produkte? Und: Anthropic redet viel über die Notwendigkeit von Sicherheit im Rahmen von immer leistungsfähiger werdender KI. Wie kann so etwas in einem Unternehmen passieren, das sich seit der Gründung Sicherheit auf die Fahnen geschrieben hat? Direkt gefragt: Wie sicher sind die internen Erkenntnisse von Anthropic vor chinesischer Spionage?

Marcel

Im Fokus dieser Ausgabe:

Öffentlich:

- Anthropic vs. OpenAI: Claude Code und Cowork treiben Anthropics Umsätze; OpenAI reagiert mit Konsolidierung, beendet Sora und plant eine Super-App.

- Bitter Lesson: Große Modelle schlagen Spezialisten fast immer; das gibt Frontier Labs enormen Spielraum und macht Führungspositionen fragil.

- Hardware-Knappheit: Der KI-Boom frisst Memory und Chips; günstige Laptops, Smartphones und Konsolen werden teurer oder verschwinden.

- Apps von neunetz.com: Sie kommen.

Für Mitglieder:

- Tech-Souveränität: KI reorganisiert SaaS; Europa hat eine einmalige Gelegenheit, sich mit chinesischen Open-Source-Modellen aus der US-Abhängigkeit zu lösen.

- Post-LLM-Wetten: LeCun sammelt $1 Mrd. für World Models in Paris; Murati sichert sich 1 GW Nvidia-Chips für Frontier-Skalierung.

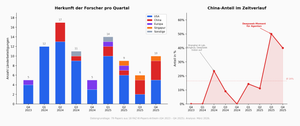

- Chinas Top-Position in der Forschung quantifiziert

- YouTube vs. KI: Deep Fakes und die Vertrauensfrage könnten zentrale Plattformen noch weiter stärken

- und mehr

Zitat des Tages

🤖 KI

High Stakes und Volatilität

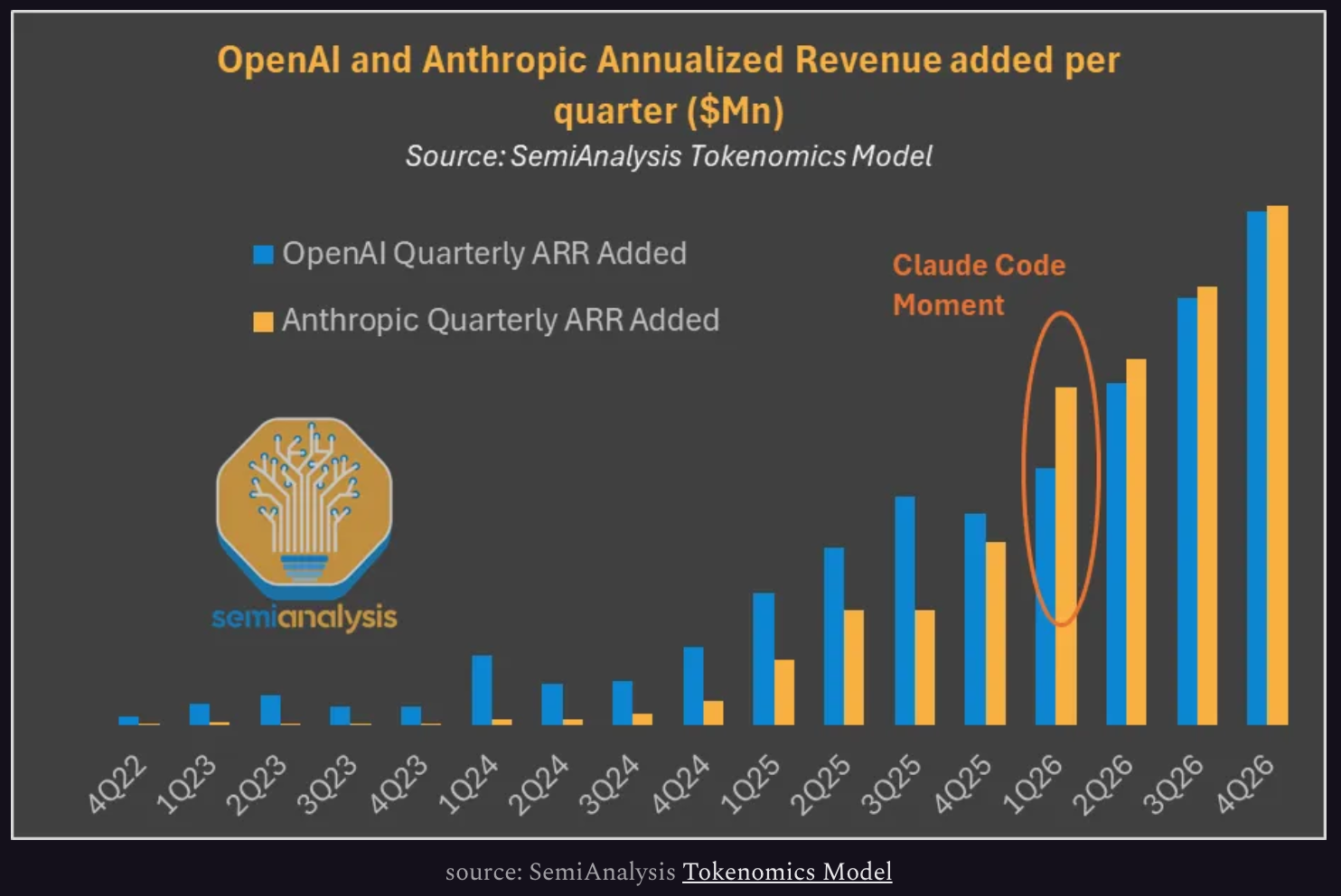

In einem vorherigen Briefing haben wir darüber gesprochen, wie rasant die Umsätze bei den KI-Startups wachsen, gleichzeitig ARR (jährlich wiederkehrende Umsätze) aber nicht so sicher sind, wie es traditionell der Fall ist.

Abo-Unternehmen wie Netflix oder Spotify sind sehr viel stabiler als KI-Abonnements. Der Grund liegt natürlich in der rasanten Entwicklung der darunterliegenden Technologie.

Und darauf folgt die "Bitter Lesson", die wie eine Sturmflut immer weiter landeinwärts rollt und alles niederreißt, was vorher mühsam aufgebaut wurde.

Die Bitter Lesson (von KI-Forscher Rich Sutton, 2019) besagt im Kern:

- Methoden, die einfach mehr Rechenleistung nutzen (z. B. größere Modelle, mehr Daten), schlagen langfristig immer Methoden, bei denen Forscher versuchen, menschliches Wissen von Hand einzuprogrammieren.

- Die wichtigste Lektion der KI-Geschichte ist: Setze auf allgemeine, skalierbare Verfahren wie Suche und Lernen, statt auf clevere menschliche Abkürzungen. Denn mit wachsender Rechenpower gewinnen erstere immer.

Konkret bedeutet das etwa, dass Claudes neue Funktionalität, Grafiken zu erstellen, zügig ein Problem für Gamma und ähnliche Startups wird.

Mir ist neulich aufgefallen, dass ein wesentlicher Kritikpunkt von Laien an LLMs darauf fußt, dass die bittere Lektion nicht allgemeinhin bekannt ist. Denn tatsächlich sehen wir konkret in der Forschung, dass erstaunlicherweise die großen Modelle fast immer besser oder gleich gut abschneiden wie kleinere, spezifisch für den jeweiligen Einsatzzweck trainierte Modelle.

Ich selbst war lange davon ausgegangen, dass fokussierte kleine Modelle die großen Generalisten ablösen würden. Nachdem ich ungefähr anderthalb Jahre lang regelmäßig Papers betrachtet und darüber geschrieben habe, in denen Forscher große und kleine Modelle verglichen, habe ich irgendwann von dieser irrigen Annahme Abstand genommen.

Aktuell überwiegen noch die emergenten Fähigkeiten in den großen Modellen gegenüber jedem Vorsprung, der sich bei kleineren Modellen aus Spezialisierung ergibt.

Das bedeutet leider auch, dass die Frontier Labs enorm viel Spielraum haben, was ihre Produkte angeht.

Das bedeutet auch, dass schneller als gedacht Führungspositionen erodieren können. Weil signifikante Modellsprünge universell branchenübergreifend Mehrwert stiften können.

Wachablösung: Anthropic macht OpenAI den KI-Thron streitig

Zum Jahreswechsel ist etwas sehr Signifikantes passiert. Zum einen veröffentlichte Anthropic im November Opus 4.5. Zum anderen brachte Anthropic Anfang 2026 erst Claude Code und dann Claude Cowork in die Desktop-App. (siehe unter anderem Briefing 278)

Opus 4.5 (und nun 4.6) hat Claude weiter als Coding-Default etabliert. Neben dem starken Modell unter der Haube sind es die konstant anwachsenden Funktionen in Claude Code (im CLI wie auch in der Desktop-App), die den Unterschied machen. Exemplarisch aus diesem LinkedIn-Post:

73 releases in 52 days isn't just a flex about talent. It’s a warning shot about the new physics of software engineering.Anthropic is internally eating their own dog food. They are using unlimited tokens and agentic workflows to build Claude with Claude.And they just proved a terrifying reality for traditional tech companies

(Hervorhebung von mir)

Es ist nicht mehr Code (allein). KI-First-Teams sind geradezu unheimlich schnell, wenn sie wirklich all-in gehen. Es ist wenig überraschend, dass das zuerst bei den führenden KI-Labs passiert. (Es wird Jahre dauern, bis wir das in allen Branchen sehen werden.)

Aber machen wir einen Schritt zurück: Wir haben mehrfach im Briefing darüber geschrieben, dass die LLMs immer mächtiger werden, es aber noch an Produkten fehlt, die die mächtige Technologie wirklich zu nutzen wissen. Das hat sich bereits geändert. Claude ist erfolgreich, weil es die mächtigsten Modelle mit sinnvollen Produkten vereint.

Mehr noch als Claude Code ist Claude Cowork das eigentliche Produkt, das den Durchbruch darstellt. Die Möglichkeit von Claude Code, auf Ordner zuzugreifen, wurde bereits letztes Jahr von Verrückten verwendet, um bei ihrer Arbeit zu helfen. Cowork ist das Produkt, das auf diese Nutzung folgt.

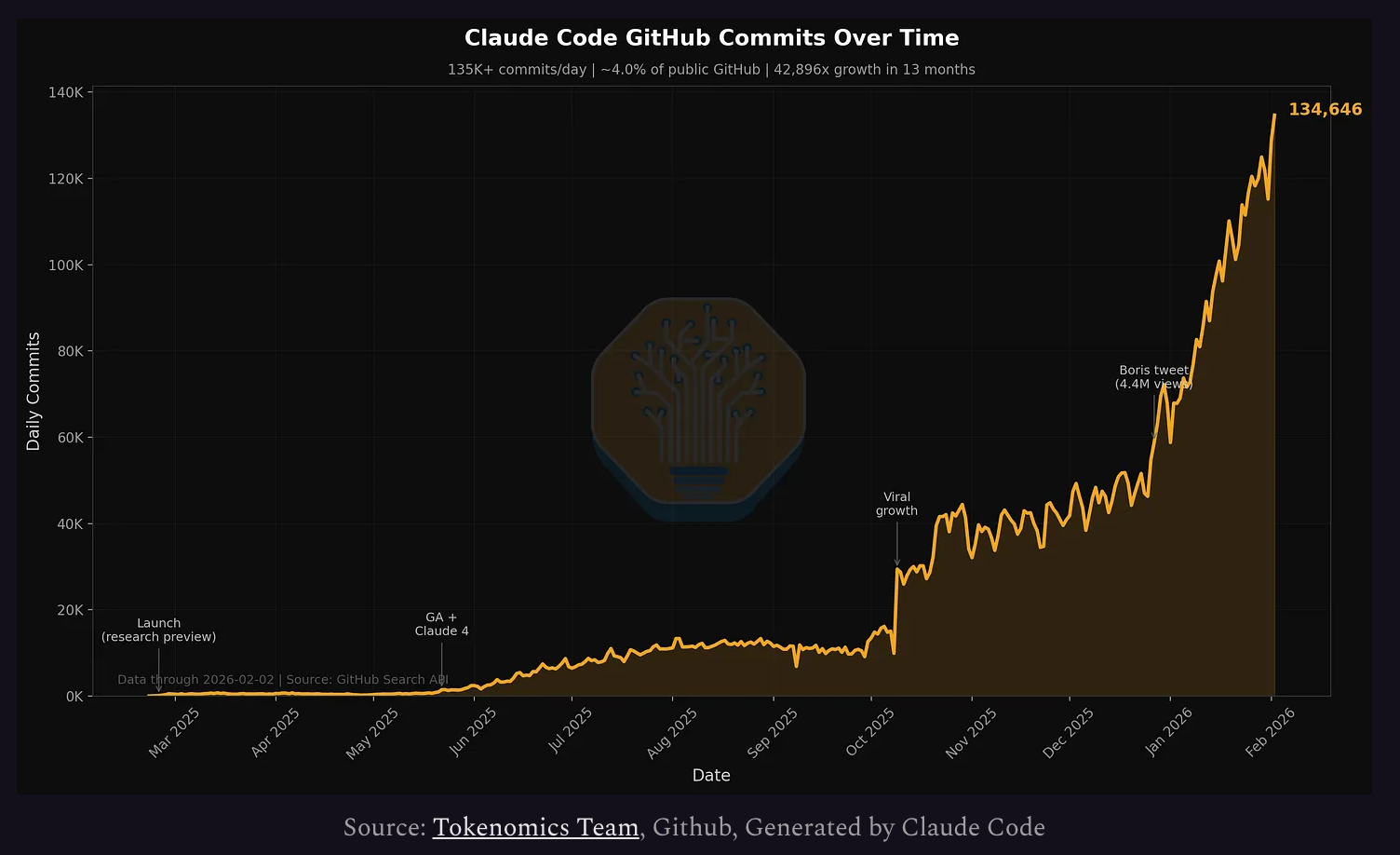

SemiAnalysis nennt Claude Code den Inflection Point. Bis Ende 2026 sollen >20% aller Daily-Commits auf Github von Claude Code kommen.

Einen ähnlichen, zeitlich versetzten, leider so nicht öffentlich messbaren, Anstieg dürfte Claude Cowork gerade erleben.

We believe that Claude Code is the inflection point for AI “Agents” and is a glimpse into the future of how AI will function. It is set to drive exceptional revenue growth for Anthropic in 2026, enabling the lab to dramatically outgrow OpenAI.

(Hervorhebung von mir)

Ich habe erste Schätzungen gesehen, dass Anthropic Mitte des Jahres OpenAI bei jährlich wiederkehrenden Umsätzen eingeholt haben könnte.

It’s Produktivitätsapps, stupid. Dafür zahlen User.

OpenAI hat weitaus mehr User als Claude, aber die wenigsten bezahlen für den Dienst. Das liegt in der Natur des Consumer-Bereichs. Und OpenAI hat zu spät angefangen, Werbung auszurollen. (Sie liegen wohl aktuell bei 100 Mio. $ pro Jahr. (Information via LinkedIn))

Das ist ein Problem für OpenAI:

Denn bis zur aktuellen Umsatzexplosion war OpenAI das Default-Startup im Westen, in das man als Investor investiert, wenn man bei KI vorn dabei sein will. Der frühe, gesetzte Marktführer in jeder Kennzahl.

Das machte es vergleichsweise (also "vergleichsweise", gemessen an den immensen Summen) einfach, Risikokapital einzusammeln. Das wiederum ist notwendig, um die Rechenzentren zu finanzieren, um einerseits die Nachfrage abzudecken und andererseits gegen den leicht blöden, aber riesigen Elefanten im Raum langfristig eine Chance zu haben. (Google)

Und so also: Panik-Modus. OpenAI:

- Beendet die KI-Video-App Sora (heise)

- Beendet Instant Checkout (CNBC)

- Wird die drei Apps ChatGPT, Codex und Atlas (KI-Browser) in einer "Super-App" vereinen (WSJ)

- Und last but not least soll die Belegschaft noch dieses Jahr von ca. 4.500 auf 8.000 wachsen. (FT, Decoder)

FT:

The new hires will largely work across product development, engineering, research and sales. OpenAI would also step up recruitment of specialists to focus on what the company calls “technical ambassadorship”, helping businesses make better use of its tools, according to the people.

Mit den zusätzlichen, bekannt gewordenen 10 Milliarden US-Dollar (CNBC) sprechen wir nun von insgesamt 120 Milliarden US-Dollar, die in OpenAI investiert wurden. Hier geht es also langsam um richtiges Geld.

Kapitalscherze beiseite, Enterprise bietet schnell direktes Einkommen für diese Startups, die hohe Kostenpunkte haben, sowohl was Investitionen angeht (Training, Commitments für Datencenterkapazitäten) als auch was den laufenden Betrieb angeht (Inferenz der KI).

Ein verbitteter Wettbewerb zwischen Anthropic und OpenAI ist sicher auch gut für europäische Unternehmen, die einen dankbaren Absatzmarkt für die US-Labs darstellen.

(Man kann davon ausgehen, dass beide noch dieses Jahr Sales-Abteilungen in Europa aufbauen werden.)

Gleichzeitig bedeutet das alles auch, dass wenn der Fokus von OpenAI auf Enterprise und dortiges Umsatzmaximum schwenkt, das Potenzial im Consumer-Bereich für andere offen bleibt.

KI trifft alles: PlayStation wird teurer, Günstige Laptops & Smartphones werden verschwinden

Sony wird die Preise für die PlayStation 5 in mehreren Regionen, einschließlich Europa, Großbritannien, Japan und den USA, ab dem 2. April 2026 deutlich erhöhen. (t-online)

Derzeit werden vor allem Arbeitsspeicher (RAM), insbesondere DDR5-RAM, sowie Festplatten aufgrund des KI-Booms teurer.

Ich empfehle sehr dringend das Gespräch mit Dylan Patel im Dwarkesh Patel Podcast (not related).

Der SemiAnalysis-Gründer Dylan Patel spricht darin unter anderem darüber, wie konservativ nicht nur TSMC, sondern alle Halbleiterchip-Zulieferer sind, was das Thema KI angeht. Während die Hyperscaler nicht genug Chips bekommen, um die Nachfrage zu bedienen.

Grund für die Zurückhaltung sind die immensen Vorabinvestitionen, die nötig sind für einen Ausbau, den es für den KI-Boom bräuchte. TSMC und die anderen, etwa die Memory-Hersteller, müssen die Nachfrage für ihre Investitionen in zwei bis drei Jahren richtig prognostizieren. Wer falsch liegt und zu viel investiert, kann bankrott gehen.

Die extremen Kostenstrukturen im Halbleitergeschäft waren Geburtshelfer des Prinzips des Risikokapitals. Beide zusammen formten das Silicon Valley.

Wie dem auch sei, das konservative, dem KI-Boom nicht vertrauende Verhalten der Hardware-Zulieferer trifft auf, nun, den Boom und dessen Nachfrage.

Dylan Patel verweist auf die extremen Folgen, welche die damit verbundene Knappheit auf Jahre verursachen wird.

In short: Der untere Markt für PCs, Laptops und Smartphones wird mehr oder weniger verschwinden.

The bulk of the market is mid-range and low-end. It used to be that 1.4 billion smartphones were sold a year. Now we’re at about 1.1 billion. Our projections are that we might drop to 800 million this year, and down to 500 or 600 million next year.

We look at data points out of China from some of our analysts in Asia, Singapore, Hong Kong, and Taiwan. They’ve been tracking this, and they see Xiaomi and Oppo cutting low-end and mid-range smartphone volumes by half.

Geräte werden teurer werden, Produktlinien werden eingestellt.

Letzter Datenpunkt: Apple zahlte ausgewählten Hardware-Ingenieuren vor einigen Tagen einen ungewöhnlichen Bonus außerhalb der üblichen Zyklen. (Bloomberg) Grund: Verhindern, dass die Mitarbeitenden zu OpenAI oder Hark wechseln.

Tang Tan, seinerzeit VP für product design bei Apple, wechselte 2023 zu OpenAI. OpenAI arbeitet bekanntlich gemeinsam mit Jony Ive an KI-Devices. (Wir hatten im Briefing bereits besprochen, was das für Mitarbeitende bei Apple bedeutet.)

Hark wiederum ist ein neues, weiteres Startup von Brett Adcock, dem Gründer des Humanoid-Unternehmens Figure. Hark ist nach acht Monaten gerade aus dem Stealth-Modus gekommen und arbeitet ebenfalls an einem persönlichen KI-Gerät.

Auch das ist durch einen Boom ausgelöste Volatilität: Wenn ein so erfolgreicher Konzern wie Apple aus Angst um seine Mitarbeitenden Boni ausschüttet, weil acht Monate alte Startups attraktivere Arbeitsplätze darstellen.

Preview: Apps von neunetz.com

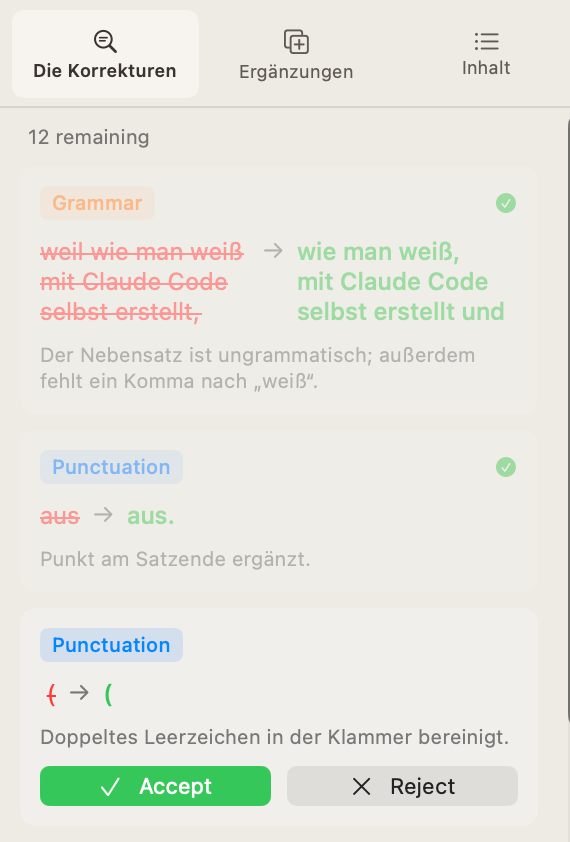

Es fing damit an, eine einfache lokale App zu bauen, die mit KI Rechtschreibung und Grammatik einer Text-Datei überprüft.

Ich ging davon aus, dass das machbar und der Aufwand überschaubar sein würde. Mir war nicht klar, wie einfach das heute ist. Ein Prompt, der aus einem einzelnen Absatz bestand, was ich insgesamt als Auftakt für die Arbeit ansah, reichte Claude Code völlig aus, um diese App-Idee umzusetzen.

Auch das meinte ich oben mit Volatilität. Die Technologie entwickelt sich so schnell weiter, dass mentale Bilder, was KI mit welcher Geschwindigkeit und Aufwand zu leisten vermag, schnell veralten. In meinem Kopf waren die Leistungsfähigkeiten von Claude Code noch dort, wo sie Anfang 2025 lagen. Weil ich die Aussagen über Opus 4.5 offenbar nicht ernst genug genommen hatte.

Das war mir aber nicht bewusst. Das wurde mir erst klar, als ich eine fertige, funktionierende App, in schönem Design und mit Features und Umsetzungen vor mir sah, an die ich noch gar nicht gedacht geschweige denn kommuniziert hatte.

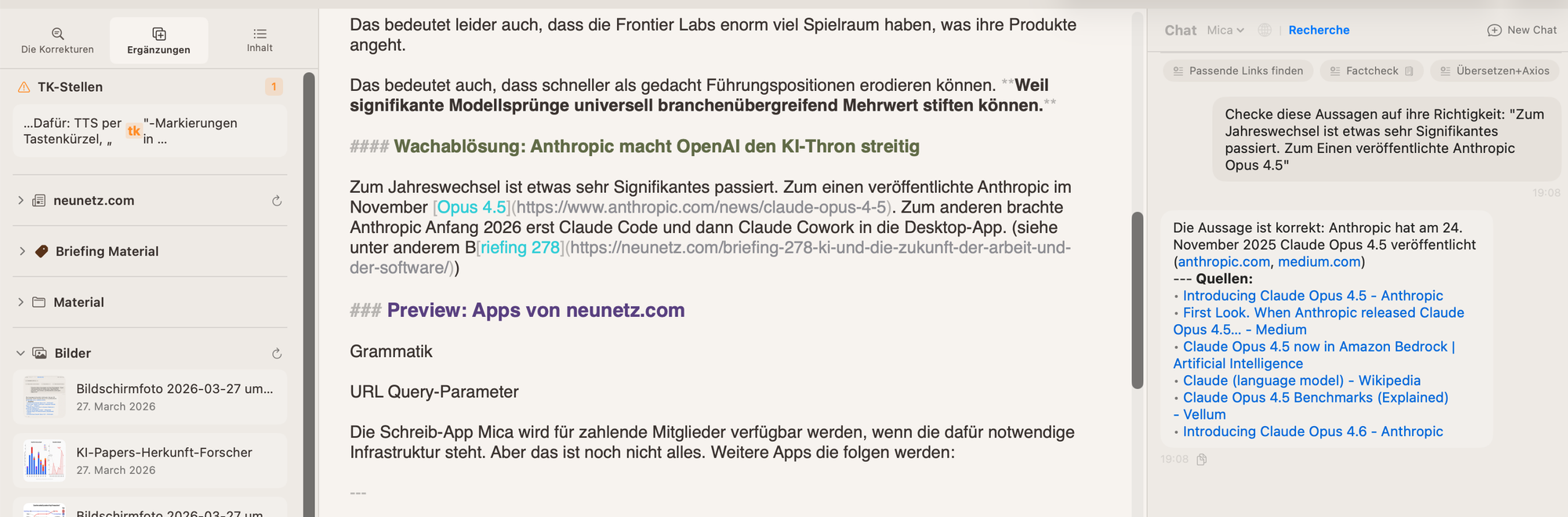

Also begann ich ein Schreibprogramm nach meinen Wunschvorstellungen zu erstellen.

Dazu zählen kleine Features wie eine native "TK"-Funktion, die mit TK markierte, noch zu bearbeitende Stellen im Text hervorhebt und gleichzeitig in der Sidebar leicht anklickbar macht. Eine Integration von Materialordnern und Bildordnern. Ein Feature, das beim Verlinken automatisch Query- und Tracking-Parameter von URLs entfernt. Und, natürlich, viele nützliche integrierte KI-Features. Und unzählige weitere Funktionen. Ein letztes Beispiel:

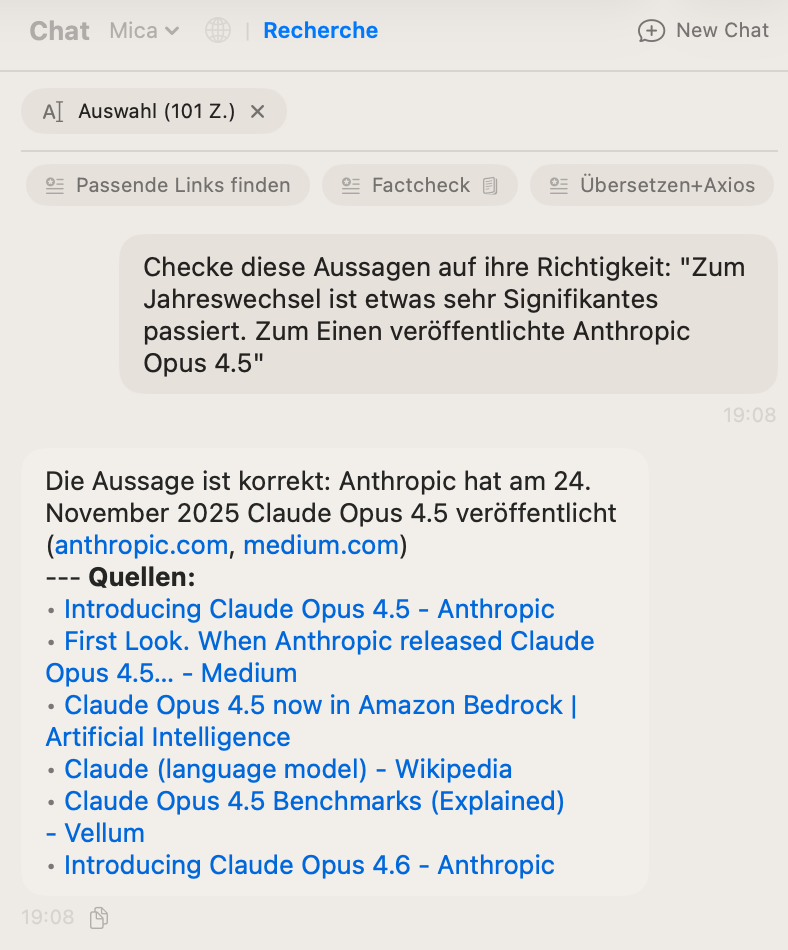

Es passiert regelmäßig beim Schreiben eines Textes, dass eine Aussage über die Tasten fliegt, von der man nicht sicher ist, ob sie stimmt. Wenn sich diese Frage über eine Internetrecherche auflösen lässt, dann seht ihr hier die denkbar reibungsfreiste Umsetzung. Der User markiert den Text mit der fragwürdigen Aussage und klickt auf einen vorher dafür angelegten Prompt-Preset. Der Prompt-Preset lädt automatisch die Selektion und führt eine Suche aus.

Das ist besonders nützlich für kleine Details, die man sonst vielleicht aus dem Text weglassen würde, wie hier im Screenshot die Modellnummer.

Habe ich das erledigt und will mich anschließend auf den Text konzentrieren, kann ich mit einem Tastatur-Shortcut alle Sidebars ausblenden oder nur die KI-Sidebar wegklappen.

Ich habe mir in den letzten Wochen ein Schreibprogramm gebaut, für das ich noch vor einem halben Jahr ohne mit der Wimper zu zucken Hundert Euro ausgegeben hätte.

Die Schreib-App Mica wird ohne zusätzliche Kosten für zahlende Mitglieder verfügbar werden, wenn die dafür notwendige Infrastruktur steht. Aber das ist noch nicht alles. Weitere Apps für Mitglieder, die folgen werden:

Lesen Sie die ganze Geschichte

Melden Sie sich jetzt an, um die vollständige Geschichte zu lesen und Zugriff auf alle bezahlten Beiträge zu erhalten.

Abonnieren