Hi,

Mythos ist relevant, aber nicht, weil es das Übermodell ist, sondern weil es abgestufte Zugänge zu neuen KI-Modellen einführt. Neben den Vorteilen für die Labs ist das auch ein Zeichen des jetzigen Zeitalters am Limit: KI wird auf absehbare Zeit an der Grenze der verfügbaren Rechenleistung laufen. Ausfälle und Einschränkungen bleiben uns vorerst erhalten.

Marcel

Im Fokus dieser Ausgabe:

- Nvidia-CEO über Chips und China

- Warum die Abstufung des Zugangs zu Anthropics Mythos bleiben wird

Für zahlende Mitglieder:

- KI am Kapazitätslimit

- KI und Pharma

- Gründe, warum SpaceX und Cursor zusammengehen wollen

- Neue mobile UI dank KI

- Investitionsentwicklung bei autonomen Autos

- und mehr

Zitat des Tages

We have a 1999 meltup in semiconductors, space and ai while the world deglobalizes, oil explodes with inflation and high rates

The markets never cease to amaze me

Nobody knows anything

Howard Lindzon auf X

🤖 KI

Jensen Huang im Interview mit Dwarkesh Patel

"You're not talking to somebody who woke up a loser. That loser attitude, that loser premise makes no sense to me. We're not a car."

Jensen Huang über die Komplexität und Abhängigkeiten des Chip-Ökosystems im Interview mit Dwarkesh Patel.

Besonders sehenswert ist das Gespräch über die Frage (Zeitstempel), ob die USA die leistungsfähigsten Chips nach China exportieren sollten oder nicht. Patel steckt tief in der Materie und kann Jensen Huang Paroli bieten wie kaum ein Journalist.

Huang beschreibt AI im Gespräch als einen “Five-Layer Cake” (Fünf-Schichten-Kuchen). Er benennt die Schichten nicht alle einzeln, aber aus dem Gespräch lassen sich die fünf Ebenen ableiten:

- Energie: Huang betont mehrfach, dass Energie die Basis von allem ist. Ohne Energie keine AI-Industrie, keine Chip-Fertigung, keine Rechenzentren. (Energie ist auch, wo Amerika und mehr noch Europa am schwächsten aktuell dasteht.)

- Chips / Halbleiter: Die Chip-Ebene, also die Fertigung von Logik (GPUs, ASICs), Speicher (HBM) und Packaging (CoWoS). Hier verortet Huang Nvidia selbst, zusammen mit der gesamten Upstream-Lieferkette (TSMC, SK Hynix, Micron, ASML etc.).

- Computing-Stack / Systemarchitektur. Hier sitzt Nvidias Plattformebene: CUDA, NVLink, die Netzwerkinfrastruktur, die Software-Bibliotheken (cuBLAS, NCCL, CUDA-X). Das ist das, was er als Nvidias eigentliche Kernleistung beschreibt, in seinen Worten die Transformation von “Elektronen zu Tokens”.

- AI-Modelle: OpenAI, Anthropic, Google DeepMind, Meta etc.

- AI-Anwendungen: Die oberste und interessanterweise laut Huang wichtigste Schicht. Die Ebene, auf der AI in die Gesellschaft diffundiert, also Agenten, Tools, branchenspezifische Software, Workflows. Er sagt: “The layer that is the most important, of course, is the AI application layer.” Wer diese Schicht am meisten nutzt, profitiert am stärksten von der industriellen Revolution.

Huangs zentrale These: Alle fünf Schichten müssen erfolgreich sein. Man darf keine Ebene opfern, um eine andere zu stärken. Die USA müssen in jeder Schicht führend sein, nicht nur bei den Modellen. Das ist sein Hauptargument gegen zu restriktive Export-Kontrollen: Wer die Chip-Ebene in einem Markt aufgibt, gefährdet den ganzen Stack. Und Chips, das heißt heute natürlich Nvidia.

Die Diskussion zwischen den beiden schält sehr gut viele der Aspekte eines der wichtigsten Themen unserer Zeit heraus.

Mythos und die Zukunft des abgestuften KI-Zugangs

Zunächst grob zu Anthropic Mythos, einem neuen Top-Codingmodell, das zuerst nur ausgewählten Organisationen bereitgestellt wird:

- Anthropic hat Claude Mythos Preview entwickelt, ein KI-Modell, das in der Lage ist, Software-Schwachstellen nicht nur zu identifizieren, sondern auch aktiv auszunutzen

- Das Modell entdeckte bei Tests etwa eine 27 Jahre alte Sicherheitslücke in OpenBSD sowie eine 17 Jahre alte Lücke in FFmpeg

- Anthropic bewertet Mythos als zu gefährlich für eine öffentliche Freigabe und stellt es stattdessen exklusiv über Project Glasswing ausgewählten Unternehmen für IT-Sicherheit sowie US-Regierungsbehörden zur Verfügung

- Das Weiße Haus plant, Bundesbehörden Zugang zu einer Version von Mythos zu gewähren

Quellen: heise online, Scientific American

Warum? Drei Gründe:

Zur Einordnung sollte man wissen, dass Anthropic-CEO Dario Amodei, bevor er Anthropic gründete, der Lead-Researcher bei OpenAI war, der die Veröffentlichung der Gewichte von GPT-2 verzögerte, weil das Modell zu gefährlich sei. GPT-2. Anthropics Gründungsanlass war es, die sichere, "gute" KI zu bauen. Anthropic ist nicht nur ein führendes KI-Lab, es ist auch ein Kult. (Das ist kein Zufall, es geht Hand in Hand. Intrinsische Motivation.) Man sollte immer vorsichtig sein, wenn ein Lab sagt, das neueste Modell sei zu gut, um es sofort der Öffentlichkeit zur Verfügung zu stellen. Besonders wenn es um diejenigen geht, die Angst vor GPT-2 hatten.

That being said, der Punkt, den Dwarkesh Patel im Podcast mit Jensen Huang macht, ist nicht von der Hand zu weisen: Die aktuellen LLMs, besonders jene von Anthropic, sind sehr gut in Coding und werden immer besser darin. Selbst wenn ein Modell "nur" inkrementell besser ist, was auf Mythos mehr oder weniger zuzutreffen scheint, dann bedeutet das trotzdem Folgendes: Mit jedem neuen Modell steigen die Fähigkeiten für die externe Untersuchung von Systemen und von Open-Source-Frameworks für Angriffspunkte.

Man könnte auch sagen "Mit jeder neuen Modellgeneration steigen..", denn die Durchbrüche bei Anthropic sind so ähnlich auch bei OpenAI und Google zu beobachten, und, mit 6 bis 9 Monaten Verspätung, bei den offenen Modellen aus China.

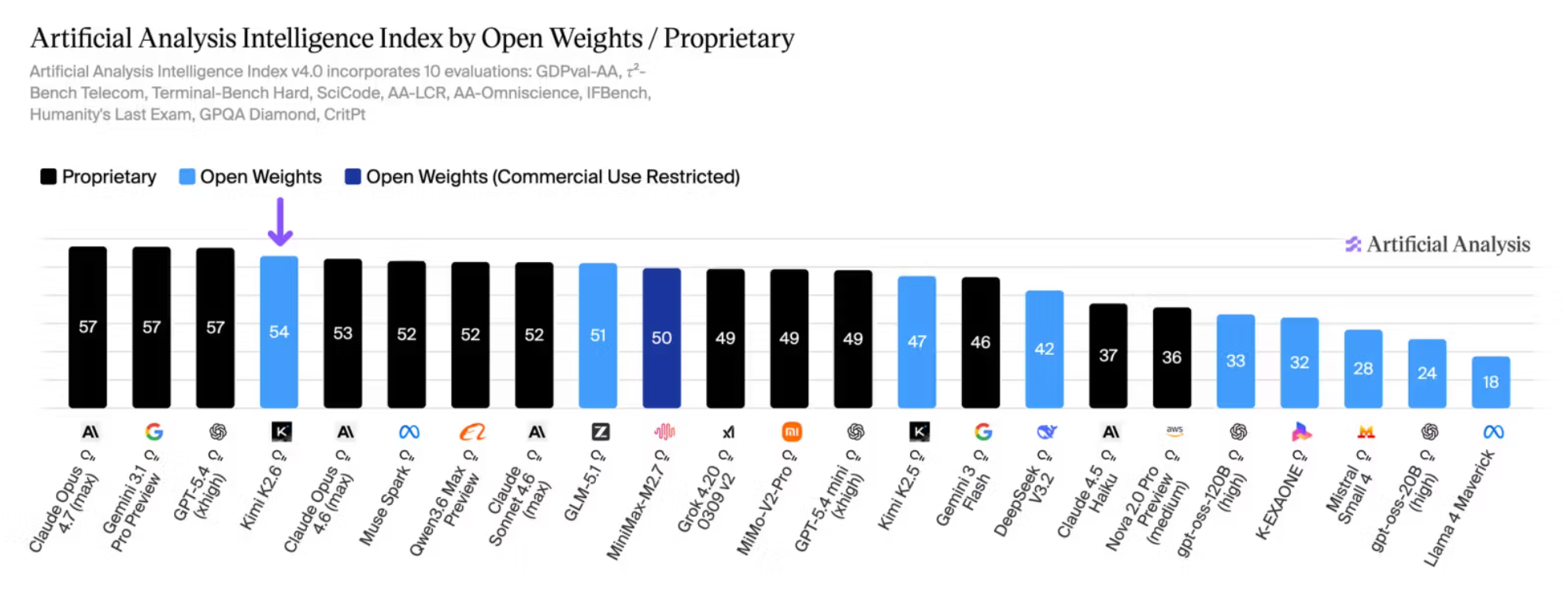

Das brandneue Kimi K2.6 deutet an, dass die Lücke sehr viel kürzer geworden sein könnte, vielleicht nur Wochen:

Quelle: Artificial Analysis

Wäre nicht vor ein paar Tagen Opus 4.7 erschienen, wäre Kimi K2.6 das erste offene Modell gewesen, das vor Anthropics Modellen in den Benchmarks gelandet wäre. (Das bezieht sich auf eine Vielzahl an Aufgaben, es bedeutet nicht, dass K2.6 besser in Programmieraufgaben ist als das vorletzte Anthropic-Modell Opus 4.6, was nicht der Fall ist.)

Anthropic gibt also ausgewählten Organisationen einen Vorlauf, bevor Angreifer die gleichen Möglichkeiten erhalten. Dieses Argument hält auch, wenn es nur inkrementell ist, weil wir ein allgemeines Qualitätslevel erreicht haben, das signifikant genug ist, um mit einer leichten Qualitätsverbesserung direkt vorher unsichtbare Angriffsfläche freizulegen. Möglich, dass Mythos nicht der Security-Urknall ist, für den viele ihn halten. Aber der Trend hält.

Siehe zur Einordnung auch Mozilla:

As part of our continued collaboration with Anthropic, we had the opportunity to apply an early version of Claude Mythos Preview to Firefox. This week’s release of Firefox 150 includes fixes for 271 vulnerabilities identified during this initial evaluation. [...]

So far we’ve found no category or complexity of vulnerability that humans can find that this model can’t.

Und was, wenn es nur um die Ressourcen geht, die bei Anthropic dank hoher Popularität rar sind?

Die FT hat Quellen:

Multiple people with knowledge of the matter suggested Anthropic was holding back from a wider release until it could reliably serve the model to customers.

Opus 4.7 hat einen neuen Tokenizer (Wandler zwischen der Modell-internen Repräsentation und natürlicher Sprache). Das ist der beste Beweis, den man von außen bekommt, dass Opus 4.7 auf einem neuen Base-Modell basiert. (Also ein neu trainiertes Modell.)

Der Experte Alexander Doria auf X:

Likely very large, super sparse MoE, maybe 40B active still but from a 5-10T base. Even with low active params count, an actual challenge to deploy as all-to-all routing stretch the limit of current infrastructure, and you cannot avoid some interconnect (so rewriting kernels, NVLink). Gradual deployment makes sense not only due to lack of compete but hard to guarantee serving without controlled demand from vetted orgs. OpenAI likely to do the same.

Die Ressourcenknappheit und technologische Herausforderung besonders große Modelle zur Verfügung zu stellen gibt Management bei Anthropic (als auch bei OpenAI) einen internen Argumentationspfad, neue Modelle künftig immer abgestuft anzubieten. Selbst 2, 3 Wochen reichen dafür schon aus.

Der große Vorteil davon ist offensichtlich: Die Labs bekommen direkte Beziehungen zu Großkunden, die alle den frühen Zugang haben wollen. Das ist marketing/salesseitig nicht zu unterschätzen.

Oder plump gesagt: Die Frontier-Labs entdecken gerade Release-Fenster, wie wir es von Filmen (Kino -> Blu-ray -> Streaming/TV) und Büchern (Hardcover -> Taschenbuch) kennen.

Prognose und was Releasefenster für Europa bedeuten

Bis jetzt hatten wir in KI ein besonderes Plattformparadigma, das sich darin äußerte, dass die (vermeintlich) wichtigste Komponente, das Modell, auch per API verfügbar ist. Daran wird sich per se nichts ändern. Aber je mächtiger die Modelle werden, desto weniger ergibt eine Self-Serve-API Sinn. Wir werden unterschiedlichste Experimente der Abstufungen sehen.

Durchaus denkbar, dass der frühe Zugang zu neuesten Modellen, der Sicherheit der eigenen Systeme sicherstellt, gekoppelt wird an Mindestanforderungen an Verträge (Umsatz, Laufdauer, etc.). Hier trifft es eben auch wieder europäische Unternehmen, die keine Frontier-Labs vor der Haustür haben. Kurz(ish)e Wege sind wichtig, wenn direkte Beziehungen zwischen den Unternehmen wieder wichtiger werden sollten.

Ich argumentiere seit geraumer Zeit, dass Europa pragmatisch den heutigen Stand nutzen sollte, und die chinesischen Modelle mit offenen Gewichten intensiv im Produktionsalltag einsetzen sollte. Aber auch dort wird sich der Zugang verschieben.

Man sieht es bereits bei den ersten Qwen-Modellen, deren Gewichte nicht veröffentlicht werden. Auch die Lizenzen werden restriktiver. Das ist erwartbar und somit planbar.

In Briefing 215 hatte ich darüber geschrieben, was es bedeutet, wenn die Basis der SaaS-Erlöse vom Seat zum Output übergehen. In short, es wird nicht beim Output bleiben:

Die Implikationen gehen weit über das, was Levie hier andeutet, hinaus. Outcome as a Service ist kein Abomodell, bei dem "nur" virtuelle Sitze zu den Teamsitzen hinzukommen.

Outcome as a Service (OaaS) sitzt direkt an der Wertschöpfung.

Umsatzbeteiligung und Unternehmensbeteiligung sind viel naheliegendere und weitreichendere Geschäftsmodelle für OaaS.

DAS wird eine der größten regulatorischen Herausforderungen der nächsten Jahrzehnte.

KI am Kapazitätslimit

Lesen Sie die ganze Geschichte

Melden Sie sich jetzt an, um die vollständige Geschichte zu lesen und Zugriff auf alle bezahlten Beiträge zu erhalten.

Abonnieren