Hi,

diese Woche gibt es kein Freitagsbriefing für Mitglieder. Wir lesen uns nächste Woche wieder. Dafür ab nächste Woche wieder zwei Mal die Woche.

Fangen wir an,

Marcel Weiß

Im Fokus dieser Ausgabe:

- Chipindustrie ist der globalste Sektor, auch und besonders bei den Flaschenhälsen.

- LLMs werden das beste Customization-Interface für Systeme mit APIs.

- Open AI Dev Day: KI wird gleichzeitig günstiger und besser.

- Gerichtsurteil: Training von KI-Modellen verletzt NICHT Urheberrecht

- 25 Prozent der unabhängigen Musiker:innen gehen heute direkt zu TikTok und Soundcloud und verzichten nicht nur auf Labels sondern sogar auf Spotify.

- und mehr

Zitat des Tages

The net effect of this burden of regulation is that only larger companies – which are often non-EU based – have the financial capacity and incentive to bear the costs of complying. Young innovative tech companies may choose not to operate in the EU at all.

The future of European competitiveness, S. 26

Lieferketten: Spruce Pine - Der unbekannte Flaschenhals der globalen Chipindustrie

Was ich diese Woche lernte: Die Kleinstadt Spruce Pine ist der flaschenhalsigste Flaschenhals, den man sich für die Weltwirtschaft vorstellen könnte. Von da und weltweit nur von da kommt ein ultraseltenes Quarz, das weltweit für die Chipproduktion benutzt wird.

Spruce Pine liegt in North Carolina und wurde gerade vom Hurrikan Helene verwüstet.

- The Quartz Corp and Sibelco both export high-purity quartz from Spruce Pine. While there are other places to find the material, such as Russia and Brazil, this mountain town has the highest quantity of the highest purity, says Conway.

**Threat level: **A few weeks of shutdown is not the end of the world, Conway tells Axios. However, longer than that could put the industry into "another crisis." The semiconductor industry would need to find alternatives.

Ed Conway ist der Autor von Material World, einem Buch von 2023 über Rohstoffe und deren Nutzung. Siehe dazu den Perlentaucher.

Siehe zum Thema auch diesen Text in Wired von 2018.

Interessant fand ich auch diesen Thread auf X dazu.

Die Chipindustrie dürfte der denkbar globalste Sektor sein, den man sich vorstellen kann. Es geht nichts weltweit ohne, egal in welches Land man schaut, und es wird auf den fundamentalsten Ebenen von wenigen Akteuren wie TSMC oder ARM bestimmt. Das merkt man auch daran, dass die Nachfrage von Apple etwa bestimmt, was deutschen Autoherstellern und anderen die erst nach dem größten Abnehmer kommen zugeteilt wird.

Dass ein wesentlicher Bestandteil für die Produktionsumgebung ein Material ist, das global fast ausschließlich von zwei Unternehmen in einer kleinen US-Stadt abgebaut wird, passt da perfekt ins Gesamtbild.

🤖 KI

OpenAI o1 und co. als Interface für Shopify-Customization

Kurz bevor OpenAI o1 vorstellte, schrieb ich für die FAZ über Cursor, Replit Agent und die Zukunft der Anpassbarkeit: Wie KI-Programmierung selbst Nischenprodukte flexibler macht.

Darin argumentiere ich, dass bestehende Systeme mit APIs und Plugin-Architektur wie etwas Wordpress oder Shopify stark von KI-Programmiertools profitieren werden:

Man denke etwa an Plug-ins bei Shopify. Rund um das Grundangebot bildet sich auf Basis der APIs ein Ökosystem aus spezialisierten Drittanbietern: Plug-in-Entwickler und Agenturen, die sich auf Anpassung und Implementierung spezialisiert haben. [...]

Es ist wahrscheinlich, dass große, weitverbreitete Softwaresysteme mit entsprechender Integrationsarchitektur (vulgo Plug-ins) wie eben genanntes Shopify oder etwa Wordpress in ein paar Jahren dezidierte KI-Programmierungsumgebungen bekommen werden, entweder von Dritten oder von den Unternehmen der Plattformen selbst. Diese KI-Umgebungen sind dann im Grunde Proto-Plug-in-Umgebungen, die Anpassungen an jede spezifische Situation enorm erleichtern werden.

OpenAI o1, über dessen Funktionsweise ich auch ausführlich in der FAZ schrieb, spielt direkt in diesen Trend hinein:

- Automatische oder teilautomatische Umsetzung mehrstufiger Programmieraufgaben.

Das ist bereits heute nützlich, noch bevor es direkte Optimierungen für o1 gibt. Damit meine ich: Spezifisch für LLMs optimierte Dokumentation von Schnittstellen und deren Nutzung.

AI Act: Regulierung sich schnell ändernder Technologie

Im selben FAZ-Text über o1, mache ich auch eine Anmerkung zum AI Act und dessen Rechengrenze beim Training, die zwischen systemisch riskant und nicht-riskant unterscheiden sollte:

Modelle, die diesen Wert überschreiten, werden als Systeme mit „hohem systemischen Risiko" eingestuft.

Mit einem simplen, leichten Prioritätenschwenk hat o1 diesen bereits fragwürdigen Regulierungsansatz noch fragwürdiger gemacht. Denn nach o1 werden wir nun in naher Zukunft auch Modelle sehen, die weitaus weniger im Training benötigen, dafür mehr Rechenzeit in der Inferenz nutzen und in ihren Fähigkeiten alles übersteigen werden, was wir heute kennen. Auch in Open Source. Und auch lokal.

Die Grenze bei der Rechenleistung zu ziehen, mag offensichtlich erschienen haben, aber sie setzt zu viele starre Parameter voraus. Die aktuelle KI-Entwicklung ist alles andere als starr und eher überraschend in Geschwindigkeit als auch bei den Haken, die geschlagen werden.

Das Hauptproblem des AI Act ist nicht, dass KI überschätzt wird, sondern dass das Thema unterschätzt wird.

Man muss sich den AI Act vorstellen wie ein Gesetz, das versucht, alle möglichen Risiken der Nutzung von Datenbanken einzufangen. Von allen Datenbanken. Von allen Einsatzarten von allen Datenbanken. Ein solches Gesetz ist Nonsense. Es ist eine zu weitgefächerte Technologie für eine einzelne Regulierung. Too close to the metal, so to speak. Genau das ist der AI Act für KI-Modelle.

Die Folge: Eine Kaskade an Kollateralschäden und unerwarteten Effekten erster und zweiter Ordnung.

OpenAI Dev Day

OpenAI hat gestern auf seinem Dev Day einige Neuerungen vorgestellt. Real-Time-API (für Sprachinterfaces etwa) und Kostensenkung.

Siehe etwa Venturebeat: OpenAI's DevDay 2024: 4 major updates that will make AI more accessible and affordable | VentureBeat

Drei Anmerkungen von mir:

- Es wird hart unterschätzt, wie schnell gerade KI-Modelle gleichzeitig besser und günstiger werden.

- OpenAIs APIs entwickeln sich langsam zum AWS für KI. Gut für Microsoft, dessen Azure im Hintergrund die Infrastruktur für OpenAI stellt.

- KI-Agents werden damit noch wahrscheinlicher: o1, Spracheingabe und Ausgabe, günstige weiterverwertbare Outputs.

Gerichtsurteil: Training von KI-Modellen verletzt NICHT Urheberrecht

Sehr gutes Urteil, über das Joerg Heidrich auf LinkedIn berichtet:

In einem für die offene Forschung und Weiterentwicklung von Künstlicher Intelligenz (KI) in Deutschland und Europa bedeutenden Verfahren hat das Landgericht Hamburg am 27.09.2024 die Klage eines Stockfoto-Produzenten gegen den gemeinnützigen Verein LAION e.V. in allen Punkten abgewiesen. Der Verein wurde dabei von unserer Kanzlei Heidrich Rechtsanwälte PartG mbB vertreten.

Das Gericht bestätigte damit die Rechtmäßigkeit des Vorgehens des Beklagten im Rahmen der Erstellung von Trainingsdatensätzen und wies die Vorwürfe des Klägers zurück, der eine Verletzung seiner Urheberrechte geltend gemacht hatte.

🤖 KI-Training ist TDM

Kernaussage des Urteils dürfte die Bewertung des Gerichts sein, dass es sich bei der Vervielfältigung eines Bildes zum Zwecke des KI-Trainings um zulässiges Text und Data Mining (TDM) im Sinne der gesetzlichen Ausnahmebestimmungen handelt.

Wer LAION nicht kennt: LAION erstellt große, frei zugängliche Datensätze, um die Entwicklung offener KI voranzutreiben und so eine Alternative zu den geschlossenen Systemen großer Tech-Konzerne zu schaffen. LAION-Datensätze wurden etwa verwendet, um Stable Diffusion zu trainieren. LAION entwickelt auch eigene Modelle.

Es ist eine der erstaunlichsten Dinge rund um KI, dass es umstritten ist, ob die Nutzung von Daten für das Training von KI-Modellen transformativ ist.

Man kann es verwerflich finden, wenn dies ohne Erlaubnis geschieht, aber deswegen verletzt es nicht automatisch das Urheberrecht.

Themen der vorherigen Mitgliederausgaben

- Zitat des Tages

- Pattern der Woche: Social-Growthstrategien für KI angewandt

- 🤖 KI

- 📱💸 Big Tech

- 🚌 Transportsektor

- 🛒 Onlinehandel

- ✴️ Mehr Wissenswertes

🔥 Nexus 228: Amazon und Lieferketten, China und Lieferketten, Geopolitik und Lieferketten

🔥 Nexus 227: GPT-o1 zweiteilt LLM-Welt, China hat seine Startup-Landschaft zerstört

- Zitat des Tages

- Thema der Woche: OpenAI GPT-o1

- 🤖 KI

- 📺 Medienwandel und vernetzte Öffentlichkeit

- 🌐Der globale Blick

- ✴️ Mehr Wissenswertes

🔥Nexus 226: Was VW jetzt machen muss, PinDuoDuos Cashpolster, ⚡Energierevolution-Watch

🚌 Transportsektor

Stellantis und Leapmotor starten mit ersten Autos

Le Monde über die Kooperation zwischen Stellantis und dem chinesischen Unternehmen Leapmotor:

Almost a year after signing an agreement that saw Stellantis disburse €1.5 billion to become a 21% shareholder in Leapmotor, the latter is launching the T03, a small urban model priced at €19,500 (€18,900 introductory price), and the C10, a large SUV priced from €36,400. The T03, assembled from components mainly imported from China at the Stellantis plant in Tychy (Poland), could nonetheless escape the additional customs duties imposed by Europe on models made in China, and qualify for the €4,000 bonus awarded by France to the most virtuous electric vehicles, as the manufacturer has submitted an application.

(Hervorhebung von mir)

Der kleine urbane T03 wird mit Bonus also wohl zur Einführung bei 14.900€ liegen.

Entscheidend ist, dass Stellantis hier für die Distribution zur Verfügung steht:

- Die Modelle werden über ein Netzwerk vertrieben, das Stellantis-Marken wie Peugeot und Citroën einbezieht.

- In Frankreich sollen bis 2025 rund 120 Verkaufsstellen eröffnet werden, mit dem Ziel von 30.000 Fahrzeugregistrierungen bis 2027.

- Bis 2030 sollen 500.000 Fahrzeuge pro Jahr vertrieben werden, 400.000 davon allein in Europa.

- Es soll mindestens ein neues Modell pro Jahr hinzukommen bis 2027.

Aus Nexus 174 China für sich nutzen: Stellantis + Leapmotor:

Neben dem E-C3 eine weitere gute Antwort auf die kommende Welle der chinesischen E-Autos auf die Europäischen Märkte.

- Stellantis sichert sich die internationale Beteilung an Leapmotors Geschäft.

- Leapmotor profitiert von Stellantis' bestehendem Autohaus-Netz.

- Statt krampfhaft auf China zu setzen, nutzt Stellantis so seine Distributionsstärke, um bei der internationalen Expansion zumindest zu partizipieren.

Stellantis hat von allen europäischen Autoherstellern bis jetzt die beste Antwort gefunden auf die kommende chinesische Welle.

📺 Medienwandel und vernetzte Öffentlichkeit

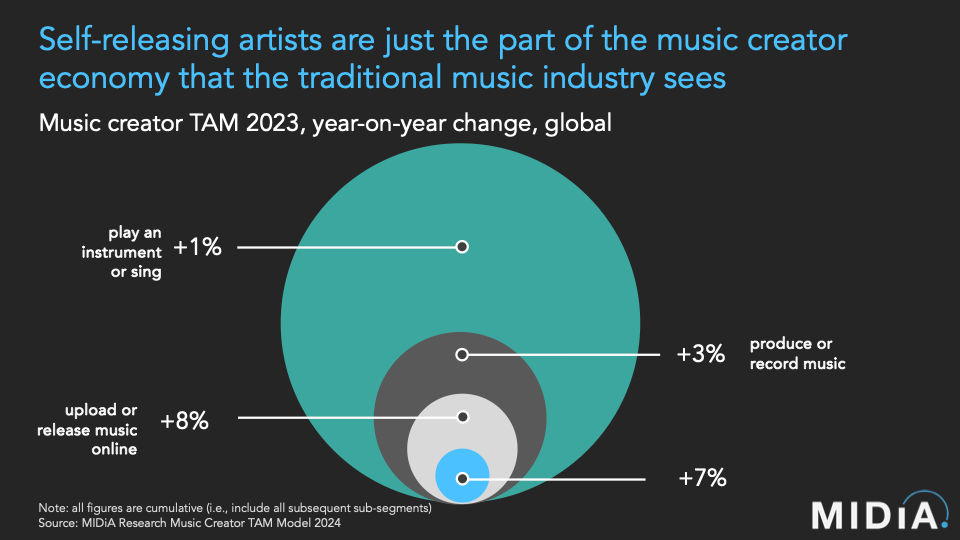

1 von 4 Indie-Musiker:innen veröffentlicht direkt auf TikTok & co.

Die Musikbranchenanalysten von Midia haben einen neuen Report vorgelegt mit interessanten Einblicken:

- 25% der Indie-Künstler veröffentlichen ihre Musik direkt auf TikTok, ohne Labels zu nutzen.

- Plattenlabels sind nur noch der kleinste Teil der Musikschaffenden-Wirtschaft.

- Viele Musiker:innen gehören zur „Lockdown-Kohorte“ und suchen die direkte Verbindung zu Fans über TikTok.

- TikTok, YouTube und Twitch ziehen Künstler von traditionellen Distributoren weg, was Labels unter Druck setzt.

Weil mit Spotify und co. so wenig zu verdienen ist und die größte Öffentlichkeit bei TikTok, YouTube et al liegt, verlieren hier sogar Spotify, Apple Music und Selfserve-Distributoren wie Distrokid an Bedeutung.

Aber es geht nicht allein, noch nicht einmal zuvorderst, ums Geld:

This new cohort of creators is driven by making the best music they can and moving people with their music, even if that is only a few people. They want creative fulfilment and high-quality fan bases rather than large-scale, anonymous audiences. They are thus gravitating to SoundCloud, YouTube, and TikTok -- places they can engage directly with fans

Eine extreme Entwicklung, die meine These in "Universal Music vs. TikTok: Wenn die Macht der Majorlabels bröckelt" nur weiter unterstreicht.

Die Zeiten ändern sich rasant.

✴️ Mehr Wissenswertes

4 Jahre Minipublikation Platformer. Schon ein paar Tage alt, ich wollte aber noch darauf hinweisen. Platformer ist letztes Jahr von Substack zu Ghost umgezogen. Sie sparen 10% Gebühr an Substack, sind aber nur um 11% bei den Einnahmen gewachsen. Trotz im selben Zeitraum komplett neu hinzugekommenem Werbeeinnahmestrom. Beste Werbung für Substack ever. What I Learned in Year Four of Platformer:

The main thing, aside from the dubious hypergrowth of our mailing list, was new paid monthly subscribers. On Substack last year, we saw substantially more readers willing to pay us $10 to try out Platformer for a month. This is likely for a mix of editorial reasons and platform dynamics. On the editorial side, we broke more news last year than we have so far in 2024. That means that last year we were getting in front of more readers, and more of those readers were happy to pay us for our scoops.

On the platform side, my leading theory is that Substack already has lots of credit cards on file, and makes it frictionless for people to upgrade their subscriptions. Whereas today, potential Platformer readers have to get their credit cards out of their wallet. That friction results in fewer subscriptions.

The flip side of this is that monthly readers on Substack churn much more aggressively than the readers who joined us this year. And while we have fewer of them than we did a year ago, our churn rate is also now much lower: it dropped more than a third, from 4.19 percent in 2023 to 2.7 percent today.

~